硬件如何促进人工神经网络的公平性

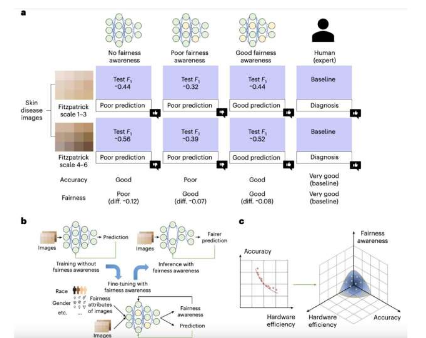

在过去的几十年里,计算机科学家开发了各种各样的深度神经网络 (DNN),用于解决各种实际任务。虽然其中一些模型已被证明非常有效,但一些研究发现它们可能存在不公平性,这意味着它们的性能可能会根据训练数据甚至部署硬件平台而有所不同。

例如,一些研究表明,市面上基于深度学习的面部识别工具在识别白皮肤人的特征方面明显优于黑皮肤人。这些观察到的人工智能性能差异,很大程度上是由于可用的训练数据存在差异,这激发了人们致力于提高现有模型的公平性的努力。

圣母大学的研究人员最近开始研究硬件系统如何促进人工智能的公平性。他们的论文发表在《自然电子》杂志上,指出了新兴硬件设计(如内存计算 (CiM) 设备)如何影响 DNN 的公平性。

论文共同作者石一宇 (Yiyu Shi) 向 Tech Xplore 表示:“我们的论文源于对人工智能公平性的迫切需求,特别是在医疗保健等高风险领域,偏见可能导致严重伤害。”

“虽然许多研究都集中在算法的公平性上,但硬件在影响公平性方面的作用却在很大程度上被忽视了。随着人工智能模型越来越多地部署在资源受限的设备上,例如移动设备和边缘设备,我们意识到底层硬件可能会加剧或减轻偏见。”

在回顾了过去关于 AI 性能差异的文献后,Shi 和他的同事意识到硬件设计对 AI 公平性的贡献尚未得到研究。他们最近研究的主要目标是填补这一空白,具体研究新的 CiM 硬件设计如何影响 DNN 的公平性。

“我们的目标是系统地探索这些影响,特别是通过新兴 CiM 架构的视角,并提出有助于确保在不同硬件平台上公平部署 AI 的解决方案,”Shi 解释道。“我们通过使用不同的硬件设置进行一系列实验来研究硬件和公平性之间的关系,特别关注 CiM 架构。”

作为这项最新研究的一部分,Shi 和他的同事进行了两类主要实验。第一类实验旨在探索不同大小和结构的硬件感知神经架构设计对所获结果公平性的影响。

“我们的实验得出了几个不仅限于设备选择的结论,”Shi 说道。“例如,我们发现更大、更复杂的神经网络往往表现出更高的公平性,而这些神经网络通常需要更多的硬件资源。然而,这些更好的模型也更难在资源有限的设备上部署。”

提示:本内容不能代替面诊,如有不适请尽快就医。